Strona WWW – jak zamówić, żeby nie żałować

Strona internetowa to must have każdej firmy – w czasach powszechnej internetyzacji to jeden z podstawowych kanałów informacyjnych, najskuteczniejsza forma prezentacji oferty, najczęściej też ważne narzędzie sprzedażowe i podstawa funkcjonowania całego biznesu. Zdarza się oczywiście, że biznesy dzieją się w realu, a strona www jest tylko dodatkiem pełniącym funkcje reprezentacyjne, ale nawet ta rola jest rolą ważną i wymaga odpowiedniej oprawy.

User experience przede wszystkim

Bez względu na to, czy użytkownik wchodzi na naszą stronę po to, by spędzić tam dwie godziny przeglądając setki proponowanych przez nas odmian tulipanów, czy raczej wpada na dziesięć sekund, żeby sprawdzić adres naszej siedziby, jego wrażenia muszą być pozytywne. User experience – hasło, które warto zapamiętać. Modne obecnie zderzenie IT i socjologii; ogół działań, które sprawić mają, żeby użytkownikowi było u nas dobrze i wygodnie, żeby z pożytkiem dla nas załatwił sobie na naszej stronie sprawy, które go do nas skierowały, żeby wrócił szybko i chętnie i jeszcze namawiał do tego innych.

Dodatkowo – należy pamiętać, że wygoda użytkownika jest dobrze oceniana przez Google, o czym pisaliśmy już na blogu przy okazji Google Mobile Friendly Update.

Firmom-krzakom mówimy NIE

Jeżeli w poszukiwaniu wykonawcy strony internetowej trafiasz na ofertę firmy, która w ciemno wycenia koszty, bez względu na to, czy rzucaną bez namysłu kwotą jest 30 zł czy 30 tys zł – uciekaj! A przynajmniej zachowaj daleko posuniętą ostrożność. Budowa strony internetowej to sprawa bardzo indywidualna. Różne strony wymagają różnych nakładów czasu wykonawcy, czyli naszych pieniędzy. Wycena bez briefu to prawdopodobnie bzdura lub zachęcający wstęp, który z biegiem czasu nieprawdopodobnie się rozrośnie.

Musisz wiedzieć, czego chcesz

Programista za Ciebie tego nie zrobi – musisz się poważnie zastanowić nad swoją stroną. Podstawowe pytanie na dobry początek: kto będzie wchodził na moją stronę i po co? Jeśli Twoje strona służyć ma przede wszystkim prezentowaniu oferty, ta oferta musi być widoczna i łatwo dostępna. Jeśli za pomocą strony chcesz się chwalić nowościami lub dzielić aktualnościami, jeśli najważniejsze treści wymagać mają zalogowania – organizacja strony będzie zupełnie inna. Inaczej będą się rozkładały priorytety, ale też funkcje – między okienkiem do logowania a galerią zdjęć jest spora różnica. Dla wykonawcy strony ten element będzie bardzo istotny – inaczej buduje się stronę składającą się z tekstu, inaczej ze zdjęć, a już zupełnie czym innym są strony zaopatrzone w funkcje: formularze, mapki i inne interaktywne elementy. Jeśli Twoja strona służyć ma przede wszystkim do wyszukiwania i bookowania lotów przez Atlantyk – musisz o tym wiedzieć i mówić, bo pod hasłem „strona o podróżach” programista może się domyślać blogu z opisami wycieczek.

Tylko skąd ich wziąć?

Dobrego wykonawcę strony internetowej, jak każde dobro, towar czy usługę, najlepiej jest zwerbować na podstawie poleceń lub wyszukując informacje o firmie odpowiedzialnej za www na stronach, które uważamy za udane. Najpopularniejszym pewnie jednak sposobem jest wyszukanie w Google. Jeśli decydujemy się na poszukiwanie tym trybem, należy koniecznie zwrócić uwagę na portfolio. Nie mniej ważna jest strona samej firmy, bo powinna być wizytówką możliwości programistów i grafików. Nieatrakcyjna strona lub rzadko aktualizowane newsy/portfolio, powinny nas zaniepokoić. Jeśli ktoś nie dba o własny wizerunek w sieci, nie zadba też pewnie o nasz.

Warto rozmawiać

Po decyzjach w zakresie potencjalnego wykonawcę, przychodzi czas na zgłoszenie zapotrzebowania. Pierwszy kontakt z wykonawcą strony internetowej to z reguły e-mail lub spotkanie – na bazie wstępnej rozmowy telefonicznej czy innej przelotnej wymiany zdań trudno jest ustalić wspólną wizję i koszty. Najlepszym sposobem na kontakt skuteczny jest przekazanie na starcie wszystkich informacji, które naszym zdaniem mogą mieć znaczenie. Nawet pozornych drobiazgów, takich jak określone upodobania graficzne albo linki do stron, które uważamy za udane. Nadmiar informacji nikomu jeszcze nie zaszkodził, a niedobór szkodzi często – nasz brief służyć ma jak najdokładniejszemu ustaleniu zakresu i czasu działań.

Pierwsze wrażenie

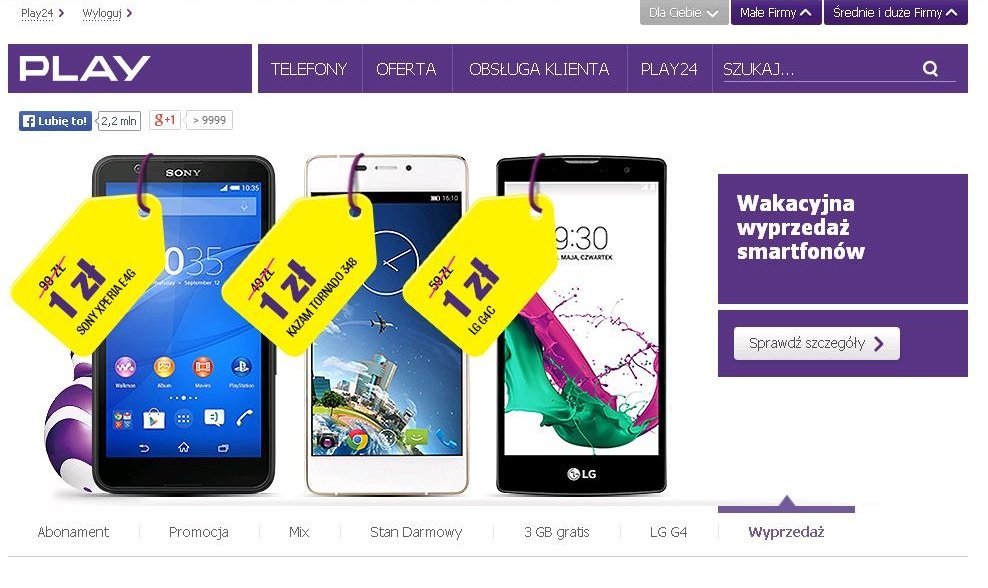

Pierwsze spotkanie z reguły ma już solidny fundament w postaci dotychczas przedstawionego zapotrzebowania. Żadna szanująca się firma nie umówi się raczej na osobiste spotkanie, jeśli nie ma przynajmniej zarysu potencjalnego projektu. Rozmowa służyć ma uzupełnieniu wiedzy wykonawców i ustaleniu wspólnego stanowiska. To moment, w którym paść powinno sakramentalne pytanie o istotę konwersji na stronie. Zleceniodawca i zleceniobiorca muszą mieć pewność, że chcą wiedzieć takie same efekty pracy. To znowu czas na przekazanie wszystkich potrzebnych i niepotrzebnych informacji, zdradzenie obaw i oczekiwań, ale też moment, kiedy należy zachować szczególną czujność, jeśli jest się stroną płacącą. Pamiętać należy, że to jest spotkanie sprzedażowe, czyli istnieje spore prawdopodobieństwo, że zostanie nam zaoferowane wiele zupełnie niepotrzebnych rozwiązań. Dobrze by było, gdybyśmy w takim momencie potrafili przywołać w pamięci na przykład widok strony Play. To jeden z dowodów na to, że nawet firmy niewątpliwie posiadające znaczące budżety na działania w internecie, decydują się na możliwie prosty layout i jedynie niezbędne funkcje, choć przecież wszystko mogłoby tam grać i śpiewać.

Klęska urodzaju

Nadmiar funkcji i możliwości to tylko jeden z przykrych scenariuszy. Drugim, bardzo prawdopodobnym, jest nadmiar kreatywności przy kształtowaniu narzędzi niezbędnych. Konstruując formularz, przygotowując tekst na stronę, zawsze należy mieć na uwadze wygodę odbiorcy – jak szybko znajdzie niezbędne informacje, jak sprawnie wyśle zapytanie? Od naszych decyzji zależy, czy uwaga osoby odwiedzającej witrynę skoncentruje się na sprawach istotnych, czy raczej rozpierzchnie się w wyniku konieczności zamykania miliona wyskakujących dodatkowych okien lub w skutek pojawiających się w zasięgu wzroku atrakcyjnych treści. W rozsądnej konstrukcji strony pomóc powinien dobry wykonawca, jednak nie jest to obowiązkowe – zawsze możemy mieć pecha i trafić na egzemplarz mało inwazyjny albo na zwykłego oszusta, które ucieszy niepotrzebna czaso- i pieniądzchłonność zlecenia.

Responsywność i nie tylko – to się może przydać

Więcej nie zawsze znaczy lepiej, jednak pewnych działań nie powinniśmy sobie odmówić. Strona internetowa powinna być mobile friendly, jak było już tłumaczone na blogu. Osiągnąć można ten efekt dwojako – za pomocą strony responsywnej, a więc dostosowującej się do urządzenia, na którym jest przeglądana, lub dzięki utworzeniu równoległej strony mobilnej. Rozwiązanie to zaobserwować można w przypadku większych serwisów internetowych – na telefonie czy innym mniejszym niż komputer sprzęcie na pewno zauważycie znaczące „m”, które pojawia się chociażby w adresie gazeta.pl. Wszystko zależy od skali Waszych działań. Warto spojrzeć jednak na sprawę szerzej: strona internetowa nie tylko powinna być dostępna na dowolnym urządzeniu, ale też odpowiadać na oczekiwania każdego odbiorcy. Tu pojawia się sprawa nowa i ważna: WCAG 2.0. Na wielu stronach instytucji państwowych zauważyć możecie certyfikaty czy deklaracje poświadczające, że witryna jest w pełni dostosowana do odbiorców niepełnosprawnych. To pokłosie WCAG 2.0, ale też rozsądna i przyszłościowa idea, która powinna być szerzona również na stronach komercyjnych. Zastanówcie się, w jakim stopniu takie ułatwienie poszerzy Wam target.

Narysuj mi www

Efektem pierwszej rozmowy jest najczęściej dostosowana do oczekiwań oferta, jednak to, co kusi najbardziej i najbardziej jest też przydatne, to makieta, której wykonanie oferują niektóre firmy. Makieta pozwala zobaczyć naszą stroną w zarysie, przede wszystkim zaś pozwala dokonać wstępnej oceny wykonawcy. Makieta ma na celu przedstawienie wizualne proponowanych rozwiązań, kręgosłup strony, ideę jej funkcjonalności. Polecam zainteresowanie stronami proponującymi już na etapie wstępnych rozmów takie rozwiązanie. Jak każde naświetlenie sprawy pozwala ono ocenić zamysł wykonawcy, ustalić zakres pracy i kosztów.

Nie warto oszczędzać

Tak jak zalecany jest na każdym etapie szukania wykonawcy i tworzenia strony rozsądek i zdystansowane podejście do wszystkich oferowanych nam rozwiązań, tak niezbędny jest też jednak gest. Nie oszukujmy się, strony nie stawia się co tydzień. Bardzo możliwe, że projekt, który właśnie zlecamy jakiejś firmie, zostanie z nami na lata. To inwestycja długofalowa, dlatego zabroniony jest pośpiech i nadmierna oszczędność. Pamiętajmy, że strona to wizytówka naszego biznesu czy inicjatywy. Od tej wizytówki wiele może zależeć, dlatego przyjmijmy ze spokojem, że jakość jest z reguły droższa niż bylejakość.