Mądre maszyny – narzędzia marketingu

Pamiętacie jeszcze o Big Data? Na pewno pamiętacie, trudno o tym obecnie zapomnieć. jeśli komuś się przydarzyła jednak informacyjna luka – polecam moje wyjaśnienia dotyczące tych niewyobrażalnych ilości danych, które bez przerwy pojawiają się w Internecie oraz tego, co można z nimi zrobić.

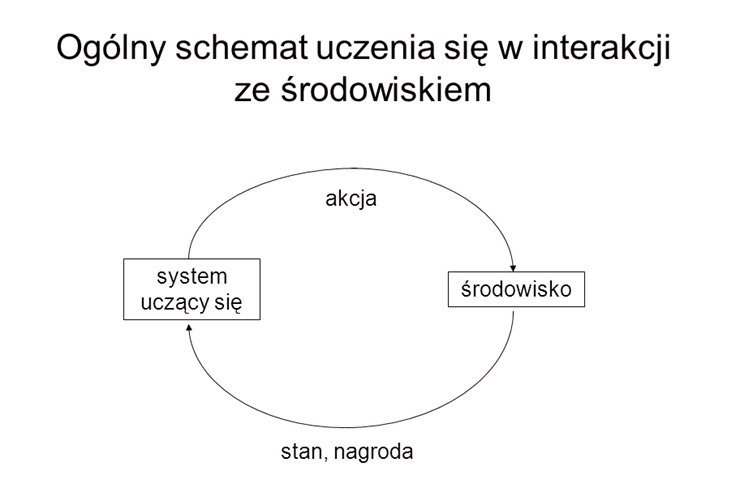

Big Data operuje na dużej ilości danych o różnej wartości – często niezwykle interesujących dla marketerów jako źródło wiedzy na temat klientów. Jak jednak wykorzystać tę wiedzę, jak ją zanalizować w czasie rzeczywistym, czyli tak, by mieć gotową odpowiedź, gdy tylko pojawi się zapytanie czy wyrażona aktywnością internetową potrzeba klienta? Człowiek jest tu zupełnie bezradny – w przeciwieństwie do maszyn, które bezustannie się uczą. Maszyny uczące się, czyli machine learning, to temat mojego ostatniego postu. Dziś zamierzam przybliżyć Wam zastosowanie uczenia maszynowego w marketingu.

Wbrew pozorom, mądrzejsze maszyny nie przełożą się — przynajmniej w najbliższym czasie – na redukcję pracowników „ludzkich”. Ucząca się maszyna – tak jak każda inna – przeglądów, doskonalenia i obsługi – osiągnięcie spektakularnych efektów jest możliwe po zintegrowaniu odpowiednich procesów, ludzi, treści, danych i informacji. Natychmiastowe korzyści wypływające z automatyzacji marketingu wyraźnie polepszają wydajność, elastyczność i kreatywność w obrębie całej firmy.

Co nam daje maszyna, która bezustannie zbiera i analizuje dane?

Dzięki takiemu rozwiązaniu szybciej, sprawniej i skuteczniej poznajemy klientów. Dowiadujemy się, kto i w jaki sposób do nas trafił, jak korzysta z serwisu i na jakiej płaszczyźnie można/należy zoptymalizować kampanie marketingowe. Wyniki pracy maszyny pozwalają zbudować strategię i nawiązać kontakt z klientem, wtedy, kiedy on tego rzeczywiście potrzebuje i oczekuje. Paradoksalnie, udział maszyny w komunikacji z klientem pozwala na budowę osobistej relacji – często przecież podstawą kontaktu są dane wrażliwe, które potencjalny klient ujawnia w sieci.

Wykorzystanie wiedzy maszyn pozwala maksymalne sprzężenie działań wszystkich działów firmy (z naciskiem na sprzedaż) i podniesienie efektów. innowacyjność, kreatywność, komunikatywność, umiejętność szybkiego przyswajania wiedzy, zdolności analityczne – brzmi jak opis idealnego pracownika? Dodajemy do tej wyliczanki „niskie koszty eksploatacji” i już wiemy, dlaczego maszyny uczące są ważnym elementem zespołu. „Kreatywność” może budzić pewne wątpliwości – w końcu omawiamy zalety maszyny. Pamiętać należy, że odpowiednia aplikacja czy oprogramowanie to coś w rodzaju pracownika działu. Jeśli aplikacja zajmuje się przewidywalnymi, powtarzalnymi zadaniami – na przykład przypomina klientom o terminach spotkań, pozostali, żywi członkowie załogi mają czas na obowiązki wymagające większej elastyczności, pomysłowości, natchnienia. Wkład maszyny w pracę działu marketingu najlepiej jest rozpatrywać właśnie przez pryzmat jej wkładu w funkcjonowanie całej komórki, czy nawet firmy.

Warto zwrócić uwagę na kilka narzędzi marketingu, które ułatwiają działania marketingowe i wykorzystują do tego machine learning:

SAS – środowisko stworzone przez SAS Institute. Nazwa pochodzi od angielskiego Statistical Analysis System.

Funkcjonalność obejmuje m.in.:

- import i przetwarzanie danych, wyszukiwanie informacji, zarządzanie danymi oraz eksploracja danych,

- generowanie raportów i grafiki,

- analizę statystyczną,

- niezależność od platformy systemowej, możliwość prowadzenia zdalnych obliczeń.

SAS jako środowisko programistyczne umożliwia programowanie w różnych językach, w zależności od potrzeb:

- SAS 4GL – najpopularniejszy język w środowisku SAS

- SQL – język zapytań do baz danych

- SCL (Screen Control Language) – budowa aplikacji okienkowych w środowiskach graficznych, np. Windows, XWindow

- makra

- możliwość integracji z językami C, COBOL, FORTRAN, PL/I, IBM assembler

IBM Predictive Customer Intelligence personalizuje kontakt z klientem, przedstawiając rekomendacje oparte na zachowaniach zakupowych, aktywności internetowej (w tym społecznościowej) oraz innych czynnikach unikalnych dla konkretnego użytkownika. Zasada działania jest prosta: programowanie w sposób zautomatyzowany zbiera informacje z różnych źródeł wewnętrznych i zewnętrznych oraz modeluje zachowania klientów. Następnie przeprowadza ocenę alternatywnych możliwości i proponuje najlepsze działanie, jakie można podjąć na danym etapie interakcji z klientem — tak, aby proponować trafne oferty właściwym klientom w najlepszym do tego czasie.

IBM Predictive Customer Intelligence realizuje następujące funkcje:

- Analizy predykcyjne, które pomagają w przewidywaniu zachowań poszczególnych klientów.

- Zarządzanie procesami decyzyjnymi mające na celu przekształcenie oceny modelu predykcyjnego w rekomendację działania.

- Oceny w czasie rzeczywistym pozwalające generować i aktualizować prognozy na żądanie.

- Optymalizacja uwzględniająca więcej niż jedną kampanię z myślą o podejmowaniu jak najkorzystniejszych decyzji dotyczących poszczególnych klientów.

- Segmentacja klientów w oparciu o wartość w całym okresie trwania relacji — służąca klasyfikacji i zatrzymywaniu klientów.

RapidMiner dostarcza oprogramowanie, rozwiązania i usługi w dziedzinie zaawansowanych analiz, w tym analiz predykcyjnych, data mining i text mining. Pozwala automatycznie i inteligentnie analizować dane – w tym baz danych i tekstu – na dużą skalę. Nasza technologia pozwala firmom na wykonanie przy użyciu inteligentnych decyzji biznesowych oraz działań opartych na metodzie prognozowania. Flagowym produktem jest RapidMiner 4.0, najczęściej stosowana do zaawansowanej analityki platforma na rynku. Setki tysięcy aplikacji są już używane w ponad 50 krajach, zarówno jako samodzielne aplikacje, jak i silniki zintegrowane z własnymi produktami klientów; daje to silną przewagę konkurencyjną. Trudno nie wierzyć w to rozwiązanie, skoro wiemy, że zaufały mu firmy takie jak: EADS GfK, Lufthansa, PayPal, Pepsi, Sanofi, Siemens, Telenor i Volkswagen.

STATISTICA – zintegrowany pakiet oprogramowania statystycznego i analitycznego wydany przez firmę StatSoft. STATISTICA daje szeroki wybór procedur analizy i zarządzania danymi, zapewnia także wizualizację wyników analizy oraz generowanie raportów.

- 1991. Pierwsza, DOSowa wersja programu STATISTICA. Nowa, zorientowana graficznie linia programów statystycznych została wydana w marcu 1991.

- 1992. Wersja programu STATISTICA dla komputerów Macintosh

- 1993. Wersja programu STATISTICA dla systemu Microsoft Windows

- 1994-1998. Program STATISTICA w wersjach – 4.0, 4.5, 5.0, 5.1 oraz wydania ’97 i ’98

- 2001. Nowa generacja pakietu STATISTICA. Wydanie wersji 6 programu STATISTICA opiera się na architekturze COM i korzysta z nowych technologii, takich jak wielowątkowość i wsparcie dla przetwarzania współbieżnego.

- 2002-2004. Wprowadzanie rozwiązań wykorzystujących rozproszone realizowanie zadań oraz rozwiązań bazujących na interfejsie przez WWW.

Cztery narzędzia marketingu – to tylko dobry początek. W tej dziedzinie wiele się dzieje, jeszcze więcej będzie się działo z czasem. Obserwujemy:)